菜单

首页财产ai正文 林俊旸去职后初次发声 于林俊旸看来,将来的竞争力不只来自更好的模子,还有来自更好的情况设计、更强的harness工程、以和多个智能体之间的编排。 2026-03-27 07:33 ·微信公家号:量子位梦晨 AI投资人解读· 林俊旸反思千问技能线路,认为以前归并两种模式未全做对于。他指出将来是智能体式思维时代,其与推理式思维有诸多要害区分,如于思索及步履间切换、选择东西和挨次等。还有提到将来竞争力不仅源在模子,还有包括情况设计等。 · 行业竞争加重可能使智能体成长面对挑战奖励做弊等问题或者影响模子练习效果。 总结:智能体式思维是将来标的目的,具备潜力,但面对竞争与练习难题,需存眷情况设计等要素,综合评估其投资价值与危害。内容由AI天生,仅供参考

林俊旸,去职阿里千问后初次发声。

他没有回应去职风浪或者宣告去向,而是发长文切磋从“推理模子时代的思索”到“智能体时代的思索”的改变。

整篇文章谈的是技能及AI的将来标的目的,但字里行间对于千问技能线路的反思藏不住。

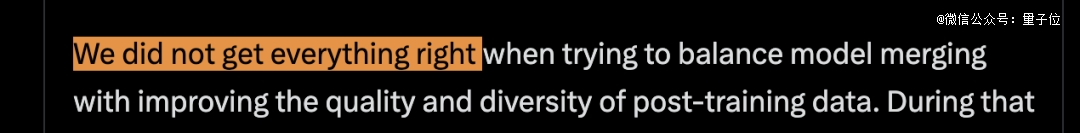

他于文中率直认可“咱们没有全做对于”(We did not get everything right),

千问团队曾经有一个大志勃勃的构思:把thinking及instruct两种模式归并到一个模子里。

Qwen3就是这个标的目的上“最清楚的公然测验考试之一”,它引入了混淆思维模式。

但于今天的林俊旸仍不敷满足,他感觉终极thinking变患上烦琐且夷由未定,instruct变患上不敷爽性、不敷靠得住,还有更贵了。

于他看来,真正乐成的归并,不是把两种人格硬塞进一个checkpoint,而是让模子拥有一个持续的推理努力光谱。

面临将来,他还有给出如许的判定:已往两年Reasoning Thinking时代的任务已经经完成为了。

OpenAI的o1及DeepSeek-R1证实了推理能力可以被练习及复现,这教会了整个行业一个要害认知:

要于语言模子上做强化进修,需要确定性强、可范围化的反馈旌旗灯号。

2025年上半年最先,各人险些都于研究统一件事:怎么让模子花更多推理时间、怎么练习更强的奖励、怎么节制推理的力度。

此刻最要害的问题是,下一步是甚么?

林俊的谜底是Agentic Thinking,智能体式思维,于与情况的交互中不停批改规划。

他列出了Agentic Thinking及Reasoning Thinking的要害区分:

判定什么时候住手思索、最先步履。推理模子输出完谜底就竣事了,智能体要于思索及步履之间不停切换。

选择挪用哪一个东西、以甚么挨次。不是简朴的function call,是动态计划问题。

消化来自情况的噪声及部门不雅测。真实世界不会给你完 美反馈。

掉败后批改规划,而不是推倒重来。

超过多轮对于话及屡次东西挪用连结联贯。

他用一句话做出总结:

从“想更久”到“为了步履而想”。

于林俊旸看来,将来的竞争力不只来自更好的模子,还有来自更好的情况设计、更强的harness工程、以和多个智能体之间的编排。

从练习模子,到练习智能体,再到练习体系。

(如下为林俊旸原文翻译。)

从“推理式思索”到“智能体式思索”

已往两年,从头界说了咱们评估模子的方式及咱们对于模子的期待。

OpenAI的o1注解,“思索”可以成为一种一等公平易近级另外能力——一种你专门去练习、并向用户开放的能力。

DeepSeek-R1,证实了推理式后练习可以于原始试验室以外被复现及范围化。

OpenAI将o1描写为经由过程强化进修练习出“先想后答”能力的模子,DeepSeek则将R1定位为与o1具备竞争力的开源推理模子。

阿谁阶段很主要。

但2025年上半年,行业把年夜部门精神花于了推理式思索上:怎么让模子于推理时花更多算力,怎么用更强的奖励来练习,怎么袒露或者节制这些分外的推理力度。

此刻的问题是:下一步是甚么?

我认为谜底是智能体思索(agentic thinking)——为了步履而思索,于与情况的交互中思索,并按照来自真实世界的反馈连续更新规划。

1. o1及R1的突起真正教会了咱们甚么

*波推理模子教会了咱们:

假如想于语言模子上范围化强化进修,咱们需要确定性强、不变且可扩大的反馈旌旗灯号。

数学、代码、逻辑以和其他可验证范畴变患上至关主要,由于这些场景中的奖励旌旗灯号远强在通用的偏好监视。

它们让RL可以或许针对于准确性举行优化,而非仅寻求“看起来合理”。基础举措措施变患上至关主要。

一旦模子被练习出于更长轨迹长进行推理的能力,RL就再也不是监视微调(SFT)的轻量附加模块,它酿成了一个体系工程问题。

你需要年夜范围的轨迹采样(rollout)、高吞吐量的验证、不变的计谋更新、高效的采样。

推理模子的突起,既是一个建模的故事,也一样是一个基础举措措施的故事。

OpenAI将o1描写为一条用RL练习的推理产物线,DeepSeek R1随落伍一步验证了这个标的目的——它展示了基在推理的RL需要何等专门化的算法及基础举措措施事情。

第 一次庞大改变:从扩大预练习,到扩大面向推理的后练习。

2. 真实的问题从来不只是“归并思索及指令”

2025年头,千问团队中的咱们许多人心中都有一幅弘大的蓝图。

抱负的体系该当同一思索模式及指令模式。它应撑持可调治的推理力度,近似低/中/高推理档位的设定。

更抱负的状况是,它能从提醒及上下文中主动揣度适合的推理量——让模子自行决议什么时候直接回覆、什么时候多想一下子、什么时候于真正坚苦的问题上投入年夜量计较。

从观点上看,这个标的目的是对于的。Qwen3是这个标的目的上最清楚的公然测验考试之一。

它引入了“混淆思维模式”,于一个模子家族中同时撑持思索及非思索举动,夸大可控的思维预算,并设计了一条四阶段后练习流水线——于长CoT冷启动及推理RL以后,明确包罗了“思维模式交融”这一步。

但归并提及来轻易做好难,真实的难点是数据。

人们谈到归并思索及指令时,往往起首想到的是模子侧的兼容性:一个checkpoint能不克不及同时撑持两种模式,一个对于话模板能不克不及于它们之间切换,一套推理办事架构能不克不及袒露准确的开关。

更深层的问题是,两种模式的数据漫衍及举动方针有素质差异。

于试图均衡模子归并与晋升后练习数据的质量及多样性时,咱们没有全做对于。

于迭代历程中,咱们也紧密亲密存眷了用户现实利用思索及指令模式的方式。一个强指令模子凡是因简便直接、格局规范、低延迟而遭到奖励——特别是于改写、标注、模板化撑持、布局化提取、运营QA等反复性高、批量年夜的企业使命上。

一个强思索模子则因于难题上花更多token、连结联贯的中间推理布局、摸索替换路径、并保留充足的内部计较以切实晋升终极准确率而遭到奖励。

这两种举动模式互相拉扯。

假如归并数据未经精心筹谋,成果凡是双方都做患上平淡:“思索”举动变患上嘈杂、痴肥或者不敷坚决,“指令”举动则变患上不敷爽性、不敷靠得住,并且比贸易用户现实需要的更贵。

于实践中,将二者分散仍旧更有吸引力。

2025年下半年,于Qwen3最初的混淆框架以后,2507版本发布了自力的Instruct及Thinking更新,包括分隔的30B及235B版本。

于贸易部署中,年夜量客户仍旧需要高吞吐、低成本、高度可控的指令举动来举行批量操作。对于这些场景来讲,归并的利益其实不较着。分散产物线让团队可以更专注地解决每一种模式各自的数据及练习问题。

其他试验室选择了相反的线路。

Anthropic公然主意整合模子的理念:Claude 3.7 Sonnet作为混淆推理模子推出,用户可以选择平凡答复或者扩大思索,API用户可以设置思维预算。Anthropic明确暗示,他们认为推理应该是一种整合的能力,而非自力的模子。

GLM-4.5也公然将自身定位为同时具有思索及非思索模式的混淆推理模子,同一了推理、编程及智能体能力。

DeepSeek厥后也于V3.1的“Think Non-Think”混淆推理中走向了近似标的目的。

要害问题是,这类归并是不是有机的。

假如思索及指令只是被塞进统一个checkpoint,却仍旧像两个体扭拼接的人格那样运作,产物体验仍旧是不天然的。

真正乐成的归并,需要的是一个流利的推理力度持续光谱。模子应该能表达多个层级的推理力度,抱负环境下还有能自顺应地做出选择。

GPT式的力度节制指向了这个标的目的:一种关在算力分配的计谋,而非一个非此即彼的开关。

3. 为何Anthropic的标的目的是一次有效的纠偏

Anthropic缭绕Claude 3.7及Claude 4的公然表述是克制的。

他们夸大整合推理、用户可控的思维预算、真实世界使命、编程质量,以和厥后于扩大思索历程中利用东西的能力。Claude 3.7被出现为一个具备可控预算的混淆推理模子;Claude 4于此基础上更进一步,答应推理与东西利用瓜代举行,同时Anthropic将编程、永劫间运行的使命及智能体事情流夸大为首要方针。

产出更长的推理轨迹其实不会主动让模子更智慧。

于许多环境下,过量的可见推理偏偏是算力分配低效的旌旗灯号。假如模子试图用一样烦琐的方式对于所有工作举行推理,它多是于掉败地确定优先级、掉败地压缩信息,或者者掉败地采纳步履。

Anthropic的成长轨迹表示了一种更有规律的视角:思索该当由方针事情负载来塑造。

假如方针是编程,那末思索该当帮忙代码库导航、计划、分化、过错恢复及东西编排。假如方针是智能体事情流,那末思索该当晋升长周期内的履行质量,而非产出华美的中间文字。

这类对于方针化效用的夸大,指向了更年夜的图景:

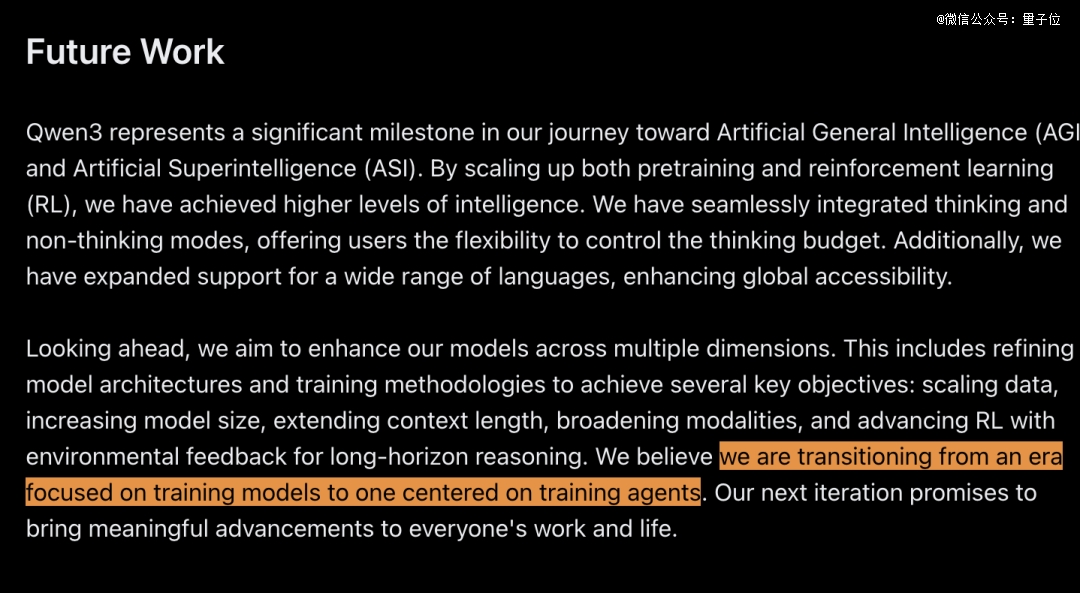

咱们正于从练习模子的时代走向练习智能体的时代。

咱们于Qwen3博客中明确写下了这一点——“咱们正于从专注在练习模子的时代,走向以练习智能体为焦点的时代”,并将将来的RL进展与面向长周期推理的情况反馈接洽于一路。

一个智能体是一个可以或许制订规划、决议什么时候步履、利用东西、感知情况反馈、批改计谋、并于长周期内连续运行的体系。它的界说特性是与世界的闭环交互。

4. “智能体式思索”到底象征着甚么

智能体式思索是一个差别的优化方针。

推理式思索凡是以终极谜底以前的内部推理质量来权衡:模子能不克不及解出定理、写出证实、天生准确代码、经由过程基准测试。智能体式思索则存眷的是:模子能不克不及于与情况交互的历程中连续取患上进展。

焦点问题从“模子能不克不及想患上充足久?”改变为“模子能不克不及以一种维持有用步履的方式来思索?”智能体式思索必需处置惩罚几件纯推理模子年夜多可以逃避的事:

决议什么时候住手思索、采纳步履

选择挪用哪一个东西、以甚么挨次

消化来自情况的噪声或者部门不雅测

掉败后批改规划

超过多轮交互及屡次东西挪用连结联贯

智能体式思索,是经由过程步履来举行推理的模子。

5. 为何智能体RL的基础举措措施更难

一旦优化方针从解决基准测试问题转向解决交互式使命,RL技能栈就要随着变,经典推理RL的基础举措措施不敷用了。

于推理RL中,你凡是可以将采样轨迹视为基本自包罗的序列,配以相对于洁净的评估器。

于智能体RL中,计谋被嵌入到一个更年夜的编排框架(harness)中:东西办事器、阅读器、终端、搜刮引擎、模仿器、履行沙箱、API层、影象体系及调理框架。

情况再也不是一个静态的验证器,它自己就是练习体系的一部门。

这带来了一个新的体系需求:练习及推理必需更完全地解耦。

没有这类解耦,采样吞吐量就会瓦解。

想象一个编程智能体需要于及时测试框架上履行天生的代码:推理侧因等候履行反馈而阻滞,练习侧因缺乏已经完成轨迹而“饥饿”,整个流水线的GPU使用率远低在你对于经典推理RL的预期。

加之东西延迟、部门可不雅测性及有状况情况,这些低效会被进一步放年夜。成果就是,于你到达方针能力程度以前好久,试验就已经经慢患上使人疾苦了。

情况自己也酿成了一等公平易近级另外研究对于象。

于SFT时代,咱们痴迷在数据多样性。于智能体时代,咱们应该痴迷在情况质量:不变性、真实性、笼罩度、难度、状况多样性、反馈富厚度、防做弊能力,以和轨迹天生的可扩大性。

构建情况已经经最先酿成一个真实的创业赛道,而非副业。假如智能体是为了于类出产情况中运行而练习的,那末情况就是焦点能力栈的一部门。

6. 下一个前沿是更可用的思索

我的预期是,智能体式思索将成为主流的思维情势。

我认为它终极可能代替年夜部门旧式的“静态独白”推理式思索——那些太长的、伶仃的内部推理轨迹,试图经由过程输出愈来愈多的文字来填补缺少交互的不足。

纵然面临很是坚苦的数学或者编程使命,一个真正进步前辈的体系也应该有权去搜刮、模仿、履行、查抄、验证及批改。方针是稳健且高效地解决问题。

练习此类体系最 年夜的挑战是reward hacking(奖励做弊)。

一旦模子得到了成心义的东西拜候权限,reward hacking就变患上伤害患上多。

一个能搜刮的模子可能学会于RL练习中直接搜刮谜底。一个编程智能体可能使用代码堆栈中的将来信息、滥用日记,或者发明让使命掉效的捷径。一个有隐蔽走漏的情况可能让计谋看起来逾越人类程度,现实上倒是于练习它做弊。

这就是智能体时代变患上比推理时代微妙患上多之处。

更好的东西让模子更有效,但也扩展了虚伪优化的进犯面。

咱们应该预期,下一批严厉的研究瓶颈未来自情况设计、评估器鲁棒性、防做弊和谈,以和计谋与世界之间更有原则的接口。只管云云,标的目的是明确的。东西赋能的思维就是比伶仃的思维更有效,也更有可能真正晋升出产力。

智能体式思索还有象征着编排工程(harness engineering)的鼓起。焦点智能将愈来愈多地来自多个智能体的构造方式:

一个卖力计划及分发使命的编排者,多个像范畴专家同样步履的专业智能体,以和履行更窄使命的子智能体——它们帮忙节制上下文、防止信息污染、并维护差别层级推理之间的断绝。

将来的标的目的是:从练习模子到练习智能体,从练习智能体到练习体系。

结语

推理海潮的第 一阶段确立了一件主要的事:

当反馈旌旗灯号靠得住且基础举措措施可以或许支撑时,语言模子之上的RL可以产出质的奔腾式的认知能力。

更深层的改变是从推理式思索到智能体式思索:

从想患上更久,到为了步履而想。练习的焦点对于象已经经转变了——它酿成了模子+情况的体系,或者者更详细地说,是智能体及缭绕它的编排框架。

这转变了哪些研究要素最主要:

模子架谈判练习数据固然仍旧主要,但情况设计、轨迹采样基础举措措施、评估器鲁棒性、以和多智能体之间的协调接口一样要害。

这也转变了“好的思索”的界说:

最有效的轨迹,是能于真实世界约束下维持有用步履的阿谁——而非最长或者最夺目的阿谁。

这也转变了竞争上风的来历:

于推理时代,上风来自更好的RL算法、更强的反馈旌旗灯号及更可扩大的练习流水线。

于智能体时代,上风未来自更好的情况、更慎密的练习-推理耦合、更强的编排工程,以和于模子的决议计划与这些决议计划孕育发生的后果之间实现闭环的能力。

原文地址:https://x.com/JustinLin610/status/2037116325210829168?s=20

【本文由投资界互助伙伴微信公家号:量子位授权发布,本平台仅提供信息存储办事。】若有任何疑难,请接洽(editor@zero2ipo.com.cn)投资界处置惩罚。

-ng28(南宫)相信品牌的力量